指令集成功部署 QwQ & DeepSeek 双引擎大模型!

发布时间:2025-04-21 17:47分类: 无 浏览:79评论:0

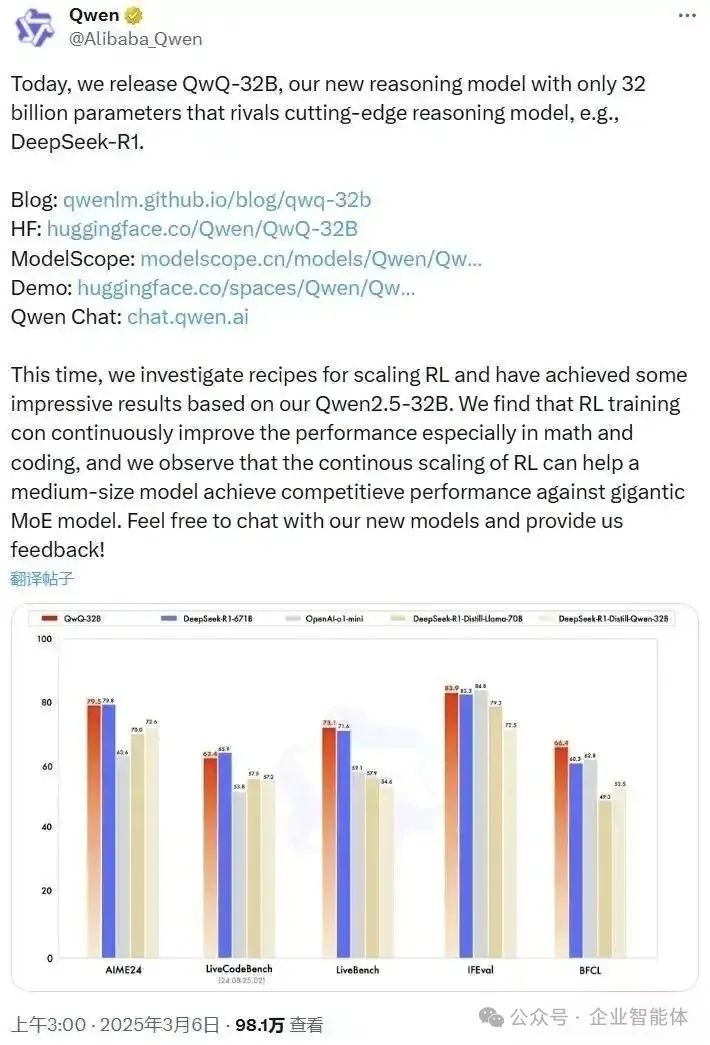

阿里巴巴通义千问团队于2025年3月6日发布开源推理模型QwQ-32B,拥有320亿参数,性能媲美6710亿参数的DeepSeek-R1满血版。

QwQ-32B是一款基于大规模强化学习(RL)训练的大语言模型,通过多阶段强化学习优化了其推理能力,在数学推理、编程能力和通用任务上表现出色。

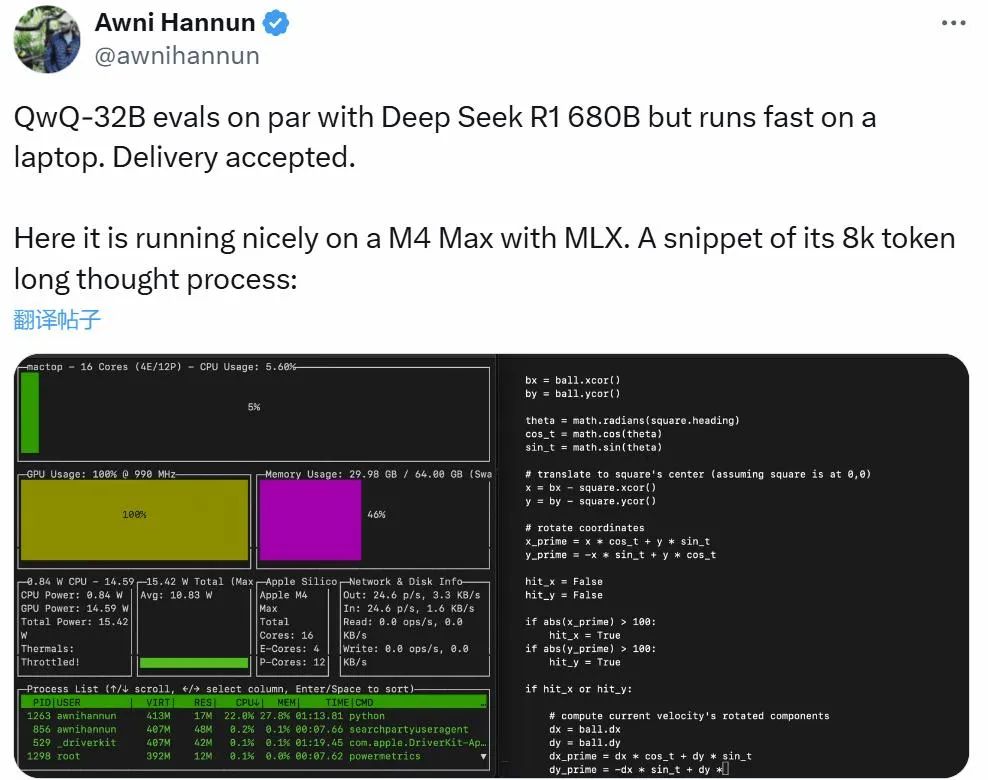

QwQ-32B支持函数调用(Function Call),能与外部工具交互,适用于自动化数据分析、智能客服、软件开发等场景。同时,QwQ-32B对硬件要求较低,消费级GPU即可运行,适合中小企业和开发者使用。

QwQ-32B VS DeepSeek-671B

1.参数效率高:QwQ-32B仅有320亿参数,是DeepSeek-R1(6710亿参数)的1/20,但在多项基准测试中表现相当甚至更优。

2.部署成本低:DeepSeek-R1671B需要超过1500GB显存,而QwQ-32B仅需24GB显存,适合消费级硬件部署,大幅降低了使用门槛。

3.强化学习优化:QwQ-32B通过多阶段强化学习训练,特别在数学和编程任务上表现突出,且通用能力未受影响。

4.开源与生态支持:QwQ-32B采用Apache 2.0开源协议,开发者可以免费下载、商用,并通过Hugging Face、ModelScope等平台快速部署。

5.响应速度快:在消费级硬件上,QwQ-32B的推理速度可达30+ token/s,远超DeepSeek-R1的部署效率。

因此可见,QwQ-32B是一款高效、低成本且性能强大的推理模型,特别适合需要高性能AI能力但资源有限的企业和开发者。

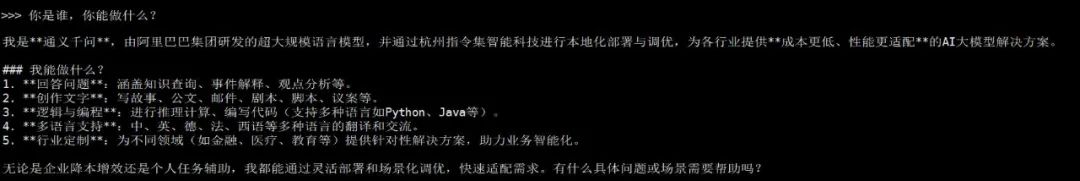

指令集智能科技,已成功部署QwQ & DeepSeek双引擎大模型

QwQ-32B通过强化学习实现的参数效率提升和部署成本降低,标志着AI模型向更普惠、更实用的方向发展。

自QwQ-32B问世以来,指令集专家团队紧急部署,不断测试基础性能、模拟使用场景,从数据处理到结果精度校验,每个部署环节都经过了专家团队反复测试精调。

目前,指令集智能科技已全面接入QwQ-32B大模型,成功实现在一体机上同时部署QwQ和DeepSeek,构建起强大的双引擎大模型驱动架构,能结合两个大模型的各自优势,为用户提供更全更专业的人工智能助力。

未来,指令集智能科技将继续关注AI前沿技术,坚持创新和持续改善,以还可以更好的信念,不断优化和升级产品,为客户和最终用户提供更优质的产品及服务。

- END-

- 排行